Asperiores, tenetur, blanditiis, quaerat odit ex exercitationem pariatur quibusdam veritatis quisquam laboriosam esse beatae hic perferendis velit deserunt soluta iste repellendus officia in neque veniam debitis placeat quo unde reprehenderit eum facilis vitae. Lorem ipsum dolor sit amet, consectetur adipisicing elit. Nihil, reprehenderit!

Non credete a quello che vedete

Il caffè delle mamme: è sempre più importante rendere attenti i giovanissimi sui rischi del deepfake

Simona Ravizza

Capiamo subito qual è la posta in gioco con un caso emblematico che al Caffè delle mamme ci fa discutere per giorni: lo scorso autunno sui gruppi WhatsApp di classe di Almandralejo, una piccola cittadina spagnola, arrivano le foto di 20 studentesse tra gli 11 e i 17 anni completamente nude. Le giovani dicono di non aver mai realizzato scatti senza vestiti. Cos’è successo allora? Gli autori, compagni di scuola e conoscenti delle vittime, hanno utilizzato immagini postate sui profili Instagram delle ragazze in cui comparivano perfettamente vestite e le hanno modificate con un’app di intelligenza artificiale (AI) in grado di generare foto di nudo sulla base di immagini innocue. Persino una delle madri che ha portato all’attenzione del pubblico il caso ha dichiarato di aver dovuto studiare con attenzione la fotografia di sua figlia prima di riconoscere che si trattava di un falso.

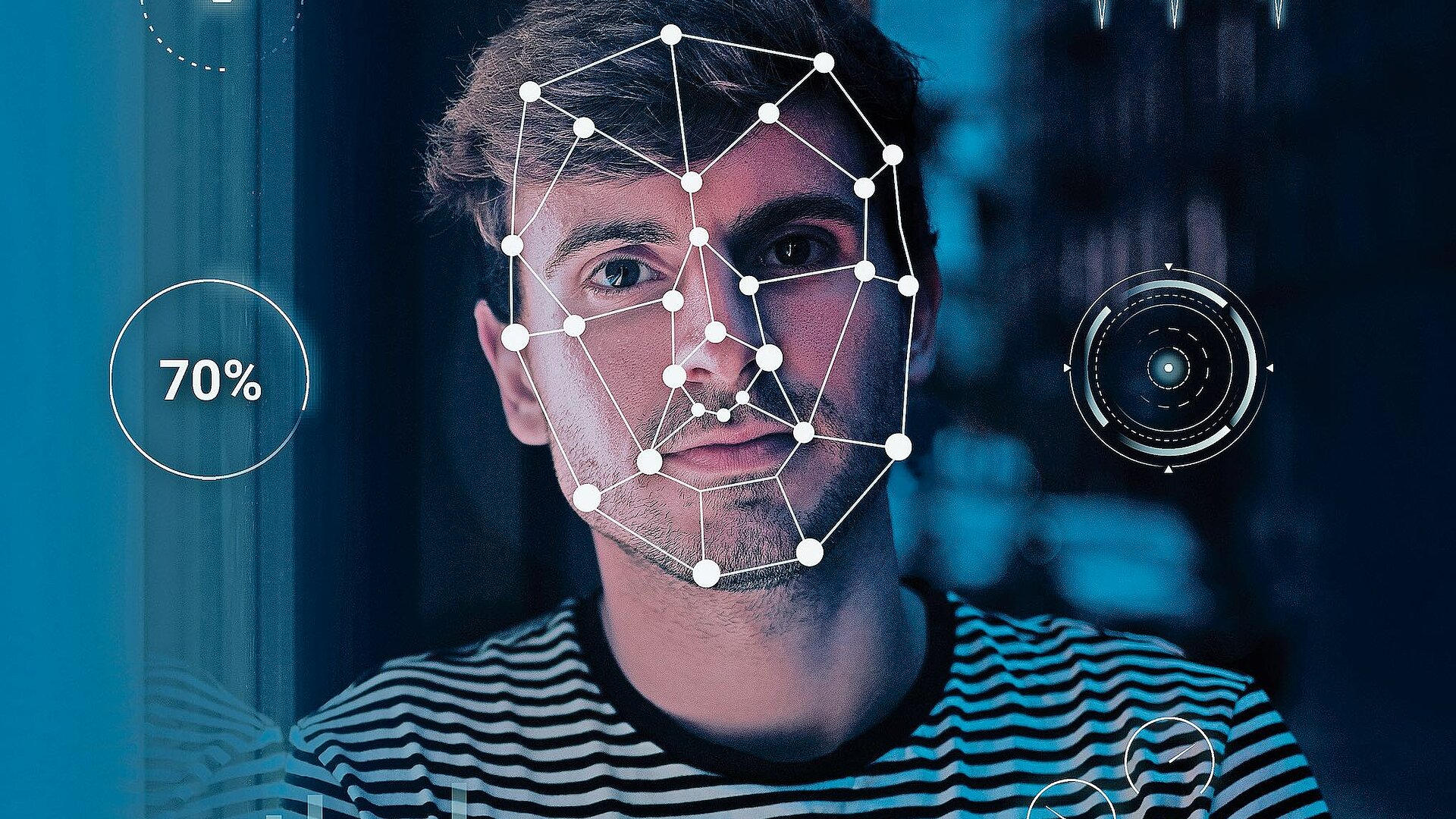

Probabilmente è anche questo uno dei motivi per cui il portale informativo www.giovaniemedia.ch, che la Confederazione considera uno dei suoi strumenti principali per sostenere genitori e insegnanti nell’accompagnare i bambini e gli adolescenti a usare i media digitali in modo sicuro e responsabile, lancia un invito che al Caffè delle mamme non può cadere nel vuoto: «Guardate assieme ai vostri figli qualche esempio di deepfake per aiutarli a sviluppare una certa consapevolezza su ciò che richiede scetticismo». Di che cosa stiamo parlando? Il termine deriva da deep learning, che è il sistema di apprendimento automatico alla base del funzionamento dell’intelligenza artificiale, e da fake, cioè falso: si tratta, dunque, di foto, video e audio creati grazie a software di intelligenza artificiale che, partendo da immagini e audio reali, riescono a modificare o ricreare in modo estremamente realistico contenuti falsi. Gli esempi più famosi di deepfake sono quelli di Papa Francesco che compare con un piumino bianco alla moda; il presidente russo Vladimir Putin che s’inginocchia con riverenza davanti al presidente cinese Xi Jinping; o ancora Donald Trump che viene arrestato; oppure il video in cui il presidente Volodymyr Zelensky dichiara la resa in Ucraina.

Il sito giovaniemedia.ch, a cura dell’Ufficio federale delle assicurazioni sociali (Ufas), ha da poco alzato l’allerta sulla questione con un articolo di Bettina Bichsel che, tra l’altro, intervista l’assistente senior del Dipartimento di Comunicazione e Ricerca sui Media dell’Università di Friburgo Patrick Raemy: «Finora abbiamo dato molta fiducia ai contenuti audiovisivi, perché combinano informazioni sul piano audio e su quello visivo, e per questo li abbiamo sempre ritenuti attendibili – spiega –. Ora ci vuole un cambio di mentalità critico e una specie di approccio investigativo». In pratica noi genitori adesso siamo chiamati a dire ai nostri figli: «Non credete più a ciò che sentite e vedete! Non basta più vedere o ascoltare una cosa per essere certi che sia vera». Vediamo perché con l’aiuto di Pierguido Iezzi, esperto di sicurezza digitale e strategic business director di Tinexta Cyber, che ci illustra l’importanza di acquisire una conoscenza approfondita di queste tecnologie per crescere figli consapevoli e protetti.

I deepfake, creati da appassionati di tecnologia e professionisti degli effetti speciali, sono estremamente realistici e possono facilmente ingannare i giovani utenti convinti che star o influencer stiano dicendo o facendo cose che in realtà non hanno mai detto o fatto, alimentando falsi miti e informazioni errate. I nostri figli possono poi essere facilmente indotti a credere a false dichiarazioni di politici che rischiano di influenzare il loro voto e la loro percezione della politica. E, ancora peggio, come nel caso di Almandralejo, deepfake di compagni di classe diffusi per scherzo o per bullismo possono danneggiare gravemente la reputazione e la salute mentale delle vittime, che potrebbero credere di essere state filmate in situazioni imbarazzanti o compromettenti. «Come abbiamo visto i rischi sono disinformazione, manipolazione dell’opinione pubblica e perfino danni psicologici – ribadisce Iezzi –. Così nell’era digitale in cui viviamo il vecchio adagio “credi solo a quello che vedi” non è più sufficiente per proteggere i nostri figli dalle trappole della Rete. È fondamentale, allora, che genitori e insegnanti promuovano l’educazione mediatica tra i giovani che devono essere consapevoli dei pericoli delle nuove tecnologie, abituarsi a verificare l’autenticità delle informazioni e analizzarle prima di accettarle come vere». In sintesi: bisogna aiutare i nostri figli a sviluppare il pensiero critico. Per fare tutto ciò, è la convinzione di Iezzi, è necessario che anche noi adulti cambiamo mentalità, con un approccio educativo che tenga conto delle nuove tecnologie, senza tuttavia mai demonizzarle. «Con i nostri figli dobbiamo essere in grado di parlare anche di bot e robocall – insiste Iezzi –. I bot sono software che automatizzano le azioni come il follow e l’unfollow fingendo che sia un utente reale ad averle compiute in modo spontaneo e possono giocare un ruolo cruciale nella diffusione dei deepfake, condividendoli a tappeto su vari social, e generando falsi commenti o like per far sembrare il contenuto più popolare e credibile. Mentre le robocall sono chiamate automatizzate che possono riprodurre grazie all’AI la voce di qualcuno di conosciuto e che spesso sono usate per truffe. Come nelle chiamate che informano i ragazzi di aver vinto un premio, tipo uno smartphone o un viaggio. Per reclamare il premio, viene chiesto di fornire informazioni personali o di effettuare un pagamento. Attratti dall’idea di aver vinto qualcosa, gli adolescenti possono facilmente cadere in questa trappola, diventando vittime di furto di identità o frode finanziaria».

Per giovaniemedia.ch i nostri figli devono insomma abituarsi a porsi determinate domande come: il sito Internet (per esempio il sito di una testata giornalistica) su cui è stato pubblicato il materiale è attendibile? Oppure è stato diffuso (solo) sui social? Le affermazioni che la persona fa nel video hanno davvero senso? Oppure risultano piuttosto illogiche? Per riconoscere i deepfake è poi utile prestare attenzione a possibili punti deboli grazie ai quali (almeno allo stato attuale della tecnologia) è possibile rilevare indizi di manipolazione. Vediamone alcuni: mancanza di sincronizzazione delle labbra (il movimento delle labbra non corrisponde a quanto sta dicendo la persona); stranezze visive (nella foto in cui Putin è inginocchiato, le sue scarpe sono sproporzionate); parti sfumate (sono spesso presenti nelle mani o nella parte tra il collo e la testa); forma innaturale dei capelli; stranezze nell’intonazione o nella pronuncia; e visi troppo regolari o pelle liscissima. Annota Patric Raemy: «I contenuti nei social media sono spesso messe in scena. Si tratta dunque della fonte che più di tutte va considerata con molta prudenza».

Proprio sui social (Instagram) il 23 maggio sull’account di dedelate, il profilo di un giovane appassionato di Urbex (ossia di esplorazione urbana, che vuol dire arrampicarsi per ogni dove) pubblica foto e video di lui in cima al Duomo di Milano abbracciato alla statua della Madonnina che veglia sulla città. Ci si è arrampicato di notte eludendo qualsiasi tipo di sorveglianza. Al Caffè delle mamme per ore ci siamo chieste stalkerando i nostri figli se fosse un deepfake, tanto la notizia ci sembrava assurda. Invece è tutto vero! Ma questa è, forse, un’altra storia.